bubbliiiing

commited on

Commit

·

18b3ed5

1

Parent(s):

da3344d

Update high noise weight

Browse files

README.md

CHANGED

|

@@ -1,3 +1,386 @@

|

|

| 1 |

-

---

|

| 2 |

-

license: apache-2.0

|

| 3 |

-

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

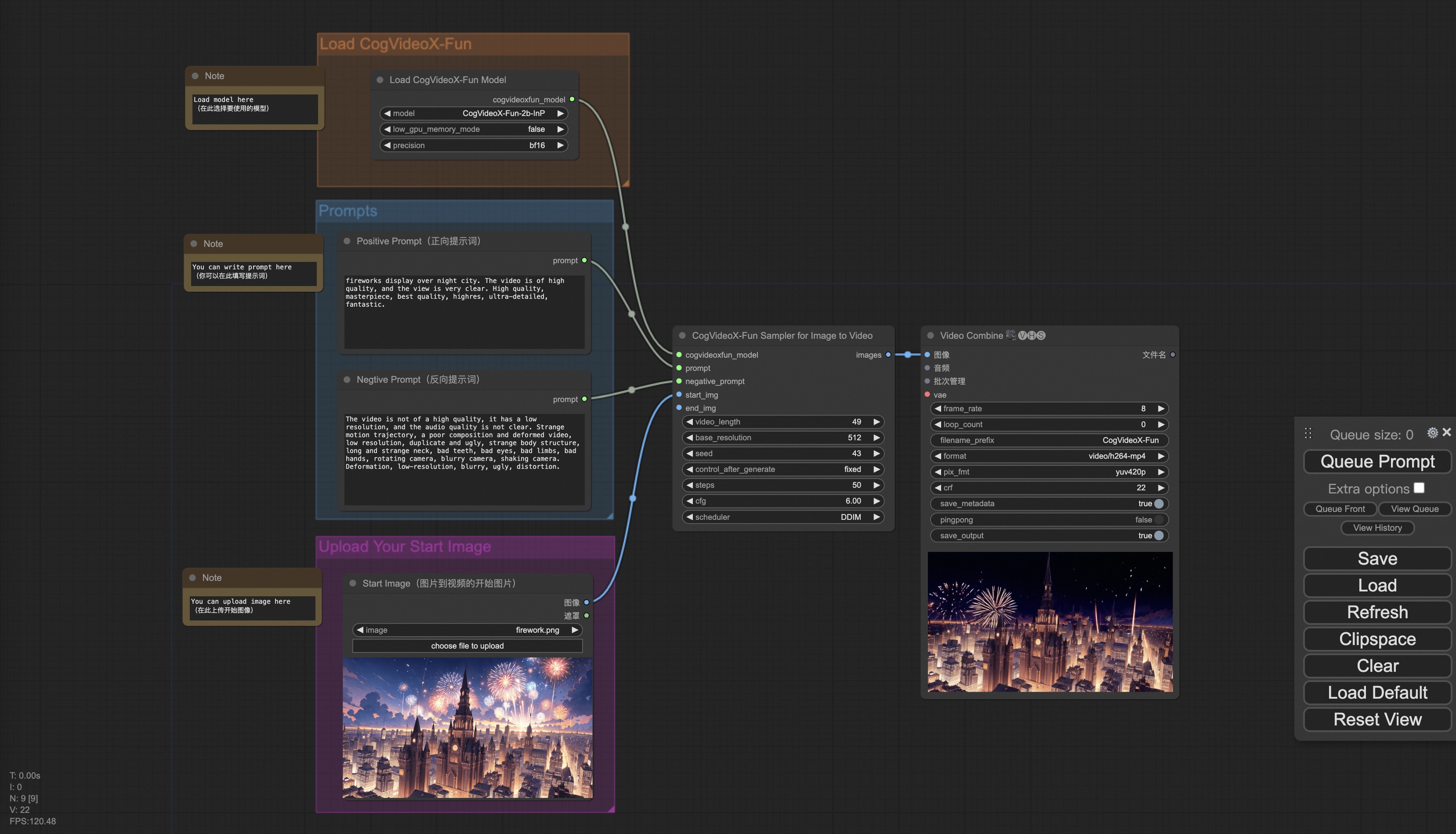

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 1 |

+

---

|

| 2 |

+

license: apache-2.0

|

| 3 |

+

language:

|

| 4 |

+

- en

|

| 5 |

+

- zh

|

| 6 |

+

pipeline_tag: text-to-video

|

| 7 |

+

library_name: diffusers

|

| 8 |

+

tags:

|

| 9 |

+

- video

|

| 10 |

+

- video-generation

|

| 11 |

+

---

|

| 12 |

+

|

| 13 |

+

# Wan-Fun

|

| 14 |

+

|

| 15 |

+

😊 Welcome!

|

| 16 |

+

|

| 17 |

+

[](https://huggingface.co/spaces/alibaba-pai/Wan2.1-Fun-1.3B-InP)

|

| 18 |

+

|

| 19 |

+

[](https://github.com/aigc-apps/VideoX-Fun)

|

| 20 |

+

|

| 21 |

+

[English](./README_en.md) | [简体中文](./README.md)

|

| 22 |

+

|

| 23 |

+

# 目录

|

| 24 |

+

- [目录](#目录)

|

| 25 |

+

- [模型地址](#模型地址)

|

| 26 |

+

- [视频作品](#视频作品)

|

| 27 |

+

- [快速启动](#快速启动)

|

| 28 |

+

- [如何使用](#如何使用)

|

| 29 |

+

- [参考文献](#参考文献)

|

| 30 |

+

- [许可证](#许可证)

|

| 31 |

+

|

| 32 |

+

# 模型地址

|

| 33 |

+

|

| 34 |

+

| 名称 | 存储空间 | Hugging Face | Model Scope | 描述 |

|

| 35 |

+

|--|--|--|--|--|

|

| 36 |

+

| Wan2.2-Fun-A14B-InP | 64.0 GB | [🤗Link](https://huggingface.co/alibaba-pai/Wan2.2-Fun-A14B-InP) | [😄Link](https://modelscope.cn/models/PAI/Wan2.2-Fun-A14B-InP) | Wan2.2-Fun-14B文图生视频权重,以多分辨率训练,支持首尾图预测。 |

|

| 37 |

+

| Wan2.2-Fun-A14B-Control | 64.0 GB | [🤗Link](https://huggingface.co/alibaba-pai/Wan2.2-Fun-A14B-Control) | [😄Link](https://modelscope.cn/models/PAI/Wan2.2-Fun-A14B-Control)| Wan2.2-Fun-14B视频控制权重,支持不同的控制条件,如Canny、Depth、Pose、MLSD等,同时支持使用轨迹控制。支持多分辨率(512,768,1024)的视频预测,支持多分辨率(512,768,1024)的视频预测,以81帧、每秒16帧进行训练,支持多语言预测 |

|

| 38 |

+

| Wan2.2-Fun-A14B-Control-Camera | 64.0 GB | [🤗Link](https://huggingface.co/alibaba-pai/Wan2.2-Fun-A14B-Control-Camera) | [😄Link](https://modelscope.cn/models/PAI/Wan2.2-Fun-A14B-Control-Camera)| Wan2.2-Fun-14B相机镜头控制权重。支持多分辨率(512,768,1024)的视频预测,支持多分辨率(512,768,1024)的视频预测,以81帧、每秒16帧进行训练,支持多语言预测 |

|

| 39 |

+

| Wan2.2-VACE-Fun-A14B | 64.0 GB | [🤗Link](https://huggingface.co/alibaba-pai/Wan2.2-VACE-Fun-A14B) | [😄Link](https://modelscope.cn/models/PAI/Wan2.2-VACE-Fun-A14B)| 以VACE方案训练的Wan2.2控制权重,支持不同的控制条件,如Canny、Depth、Pose、MLSD、轨迹控制等。支持通过主体指定生视频。支持多分辨率(512,768,1024)的视频预测,支持多分辨率(512,768,1024)的视频预测,以81帧、每秒16帧进行训练,支持多语言预测 |

|

| 40 |

+

|

| 41 |

+

# 视频作品

|

| 42 |

+

|

| 43 |

+

### Wan2.2-Fun-A14B-InP

|

| 44 |

+

|

| 45 |

+

<table border="0" style="width: 100%; text-align: left; margin-top: 20px;">

|

| 46 |

+

<tr>

|

| 47 |

+

<td>

|

| 48 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/inp_1.mp4" width="100%" controls autoplay loop></video>

|

| 49 |

+

</td>

|

| 50 |

+

<td>

|

| 51 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/inp_2.mp4" width="100%" controls autoplay loop></video>

|

| 52 |

+

</td>

|

| 53 |

+

<td>

|

| 54 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/inp_3.mp4" width="100%" controls autoplay loop></video>

|

| 55 |

+

</td>

|

| 56 |

+

<td>

|

| 57 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/inp_4.mp4" width="100%" controls autoplay loop></video>

|

| 58 |

+

</td>

|

| 59 |

+

</tr>

|

| 60 |

+

</table>

|

| 61 |

+

|

| 62 |

+

<table border="0" style="width: 100%; text-align: left; margin-top: 20px;">

|

| 63 |

+

<tr>

|

| 64 |

+

<td>

|

| 65 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/inp_5.mp4" width="100%" controls autoplay loop></video>

|

| 66 |

+

</td>

|

| 67 |

+

<td>

|

| 68 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/inp_6.mp4" width="100%" controls autoplay loop></video>

|

| 69 |

+

</td>

|

| 70 |

+

<td>

|

| 71 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/inp_7.mp4" width="100%" controls autoplay loop></video>

|

| 72 |

+

</td>

|

| 73 |

+

<td>

|

| 74 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/inp_8.mp4" width="100%" controls autoplay loop></video>

|

| 75 |

+

</td>

|

| 76 |

+

</tr>

|

| 77 |

+

</table>

|

| 78 |

+

|

| 79 |

+

### Wan2.2-Fun-A14B-Control

|

| 80 |

+

|

| 81 |

+

Generic Control Video + Reference Image:

|

| 82 |

+

<table border="0" style="width: 100%; text-align: left; margin-top: 20px;">

|

| 83 |

+

<tr>

|

| 84 |

+

<td>

|

| 85 |

+

Reference Image

|

| 86 |

+

</td>

|

| 87 |

+

<td>

|

| 88 |

+

Control Video

|

| 89 |

+

</td>

|

| 90 |

+

<td>

|

| 91 |

+

Wan2.2-Fun-14B-Control

|

| 92 |

+

</td>

|

| 93 |

+

<tr>

|

| 94 |

+

<td>

|

| 95 |

+

<image src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/8.png" width="100%" controls autoplay loop></image>

|

| 96 |

+

</td>

|

| 97 |

+

<td>

|

| 98 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/pose.mp4" width="100%" controls autoplay loop></video>

|

| 99 |

+

</td>

|

| 100 |

+

<td>

|

| 101 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/14b_ref.mp4" width="100%" controls autoplay loop></video>

|

| 102 |

+

</td>

|

| 103 |

+

<tr>

|

| 104 |

+

</table>

|

| 105 |

+

|

| 106 |

+

Generic Control Video (Canny, Pose, Depth, etc.) and Trajectory Control:

|

| 107 |

+

<table border="0" style="width: 100%; text-align: left; margin-top: 20px;">

|

| 108 |

+

<tr>

|

| 109 |

+

<td>

|

| 110 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/guiji.mp4" width="100%" controls autoplay loop></video>

|

| 111 |

+

</td>

|

| 112 |

+

<td>

|

| 113 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/guiji_out.mp4" width="100%" controls autoplay loop></video>

|

| 114 |

+

</td>

|

| 115 |

+

<tr>

|

| 116 |

+

</table>

|

| 117 |

+

|

| 118 |

+

<table border="0" style="width: 100%; text-align: left; margin-top: 20px;">

|

| 119 |

+

<tr>

|

| 120 |

+

<td>

|

| 121 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/pose.mp4" width="100%" controls autoplay loop></video>

|

| 122 |

+

</td>

|

| 123 |

+

<td>

|

| 124 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/canny.mp4" width="100%" controls autoplay loop></video>

|

| 125 |

+

</td>

|

| 126 |

+

<td>

|

| 127 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/depth.mp4" width="100%" controls autoplay loop></video>

|

| 128 |

+

</td>

|

| 129 |

+

<tr>

|

| 130 |

+

<td>

|

| 131 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/pose_out.mp4" width="100%" controls autoplay loop></video>

|

| 132 |

+

</td>

|

| 133 |

+

<td>

|

| 134 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/canny_out.mp4" width="100%" controls autoplay loop></video>

|

| 135 |

+

</td>

|

| 136 |

+

<td>

|

| 137 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/depth_out.mp4" width="100%" controls autoplay loop></video>

|

| 138 |

+

</td>

|

| 139 |

+

</tr>

|

| 140 |

+

</table>

|

| 141 |

+

|

| 142 |

+

### Wan2.2-Fun-A14B-Control-Camera

|

| 143 |

+

|

| 144 |

+

<table border="0" style="width: 100%; text-align: left; margin-top: 20px;">

|

| 145 |

+

<tr>

|

| 146 |

+

<td>

|

| 147 |

+

Pan Up

|

| 148 |

+

</td>

|

| 149 |

+

<td>

|

| 150 |

+

Pan Left

|

| 151 |

+

</td>

|

| 152 |

+

<td>

|

| 153 |

+

Pan Right

|

| 154 |

+

</td>

|

| 155 |

+

<td>

|

| 156 |

+

Zoom In

|

| 157 |

+

</td>

|

| 158 |

+

<tr>

|

| 159 |

+

<td>

|

| 160 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/Pan_Up.mp4" width="100%" controls autoplay loop></video>

|

| 161 |

+

</td>

|

| 162 |

+

<td>

|

| 163 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/Pan_Left.mp4" width="100%" controls autoplay loop></video>

|

| 164 |

+

</td>

|

| 165 |

+

<td>

|

| 166 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/Pan_Right.mp4" width="100%" controls autoplay loop></video>

|

| 167 |

+

</td>

|

| 168 |

+

<td>

|

| 169 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/Zoom_In.mp4" width="100%" controls autoplay loop></video>

|

| 170 |

+

</td>

|

| 171 |

+

<tr>

|

| 172 |

+

<td>

|

| 173 |

+

Pan Down

|

| 174 |

+

</td>

|

| 175 |

+

<td>

|

| 176 |

+

Pan Up + Pan Left

|

| 177 |

+

</td>

|

| 178 |

+

<td>

|

| 179 |

+

Pan Up + Pan Right

|

| 180 |

+

</td>

|

| 181 |

+

<td>

|

| 182 |

+

Zoom Out

|

| 183 |

+

</td>

|

| 184 |

+

<tr>

|

| 185 |

+

<td>

|

| 186 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/Pan_Down.mp4" width="100%" controls autoplay loop></video>

|

| 187 |

+

</td>

|

| 188 |

+

<td>

|

| 189 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/Pan_UL.mp4" width="100%" controls autoplay loop></video>

|

| 190 |

+

</td>

|

| 191 |

+

<td>

|

| 192 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/Pan_UR.mp4" width="100%" controls autoplay loop></video>

|

| 193 |

+

</td>

|

| 194 |

+

<td>

|

| 195 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/Zoom_Out.mp4" width="100%" controls autoplay loop></video>

|

| 196 |

+

</td>

|

| 197 |

+

</tr>

|

| 198 |

+

</table>

|

| 199 |

+

|

| 200 |

+

### Wan2.2-VACE-Fun-A14B

|

| 201 |

+

Generic Control Video + Reference Image:

|

| 202 |

+

<table border="0" style="width: 100%; text-align: left; margin-top: 20px;">

|

| 203 |

+

<tr>

|

| 204 |

+

<td>

|

| 205 |

+

Reference Image

|

| 206 |

+

</td>

|

| 207 |

+

<td>

|

| 208 |

+

Control Video

|

| 209 |

+

</td>

|

| 210 |

+

<td>

|

| 211 |

+

Wan2.2-VACE-Fun-14B

|

| 212 |

+

</td>

|

| 213 |

+

<tr>

|

| 214 |

+

<td>

|

| 215 |

+

<image src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/8.png" width="100%" controls autoplay loop></image>

|

| 216 |

+

</td>

|

| 217 |

+

<td>

|

| 218 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/pose.mp4" width="100%" controls autoplay loop></video>

|

| 219 |

+

</td>

|

| 220 |

+

<td>

|

| 221 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/14b_vace_ref.mp4" width="100%" controls autoplay loop></video>

|

| 222 |

+

</td>

|

| 223 |

+

<tr>

|

| 224 |

+

<td>

|

| 225 |

+

<image src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/ref_1.png" width="100%" controls autoplay loop></image>

|

| 226 |

+

<image src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/8.png" width="100%" controls autoplay loop></image>

|

| 227 |

+

</td>

|

| 228 |

+

<td>

|

| 229 |

+

None

|

| 230 |

+

</td>

|

| 231 |

+

<td>

|

| 232 |

+

<video src="https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/wan_fun/asset_Wan2_2/v1.0/14b_vace_subjects.mp4" width="100%" controls autoplay loop></video>

|

| 233 |

+

</td>

|

| 234 |

+

<tr>

|

| 235 |

+

</table>

|

| 236 |

+

|

| 237 |

+

# 快速启动

|

| 238 |

+

### 1. 云使用: AliyunDSW/Docker

|

| 239 |

+

#### a. 通过阿里云 DSW

|

| 240 |

+

DSW 有免费 GPU 时间,用户可申请一次,申请后3个月内有效。

|

| 241 |

+

|

| 242 |

+

阿里云在[Freetier](https://free.aliyun.com/?product=9602825&crowd=enterprise&spm=5176.28055625.J_5831864660.1.e939154aRgha4e&scm=20140722.M_9974135.P_110.MO_1806-ID_9974135-MID_9974135-CID_30683-ST_8512-V_1)提供免费GPU时间,获取并在阿里云PAI-DSW中使用,5分钟内即可启动CogVideoX-Fun。

|

| 243 |

+

|

| 244 |

+

[](https://gallery.pai-ml.com/#/preview/deepLearning/cv/cogvideox_fun)

|

| 245 |

+

|

| 246 |

+

#### b. 通过ComfyUI

|

| 247 |

+

我们的ComfyUI界面如下,具体查看[ComfyUI README](comfyui/README.md)。

|

| 248 |

+

|

| 249 |

+

|

| 250 |

+

#### c. 通过docker

|

| 251 |

+

使用docker的情况下,请保证机器中已经正确安装显卡驱动与CUDA环境,然后以此执行以下命令:

|

| 252 |

+

|

| 253 |

+

```

|

| 254 |

+

# pull image

|

| 255 |

+

docker pull mybigpai-public-registry.cn-beijing.cr.aliyuncs.com/easycv/torch_cuda:cogvideox_fun

|

| 256 |

+

|

| 257 |

+

# enter image

|

| 258 |

+

docker run -it -p 7860:7860 --network host --gpus all --security-opt seccomp:unconfined --shm-size 200g mybigpai-public-registry.cn-beijing.cr.aliyuncs.com/easycv/torch_cuda:cogvideox_fun

|

| 259 |

+

|

| 260 |

+

# clone code

|

| 261 |

+

git clone https://github.com/aigc-apps/VideoX-Fun.git

|

| 262 |

+

|

| 263 |

+

# enter VideoX-Fun's dir

|

| 264 |

+

cd VideoX-Fun

|

| 265 |

+

|

| 266 |

+

# download weights

|

| 267 |

+

mkdir models/Diffusion_Transformer

|

| 268 |

+

mkdir models/Personalized_Model

|

| 269 |

+

|

| 270 |

+

# Please use the hugginface link or modelscope link to download the model.

|

| 271 |

+

# CogVideoX-Fun

|

| 272 |

+

# https://huggingface.co/alibaba-pai/CogVideoX-Fun-V1.1-5b-InP

|

| 273 |

+

# https://modelscope.cn/models/PAI/CogVideoX-Fun-V1.1-5b-InP

|

| 274 |

+

|

| 275 |

+

# Wan

|

| 276 |

+

# https://huggingface.co/alibaba-pai/Wan2.1-Fun-V1.1-14B-InP

|

| 277 |

+

# https://modelscope.cn/models/PAI/Wan2.1-Fun-V1.1-14B-InP

|

| 278 |

+

# https://huggingface.co/alibaba-pai/Wan2.2-Fun-A14B-InP

|

| 279 |

+

# https://modelscope.cn/models/PAI/Wan2.2-Fun-A14B-InP

|

| 280 |

+

```

|

| 281 |

+

|

| 282 |

+

### 2. 本地安装: 环境检查/下载/安装

|

| 283 |

+

#### a. 环境检查

|

| 284 |

+

我们已验证该库可在以下环境中执行:

|

| 285 |

+

|

| 286 |

+

Windows 的详细信息:

|

| 287 |

+

- 操作系统 Windows 10

|

| 288 |

+

- python: python3.10 & python3.11

|

| 289 |

+

- pytorch: torch2.2.0

|

| 290 |

+

- CUDA: 11.8 & 12.1

|

| 291 |

+

- CUDNN: 8+

|

| 292 |

+

- GPU: Nvidia-3060 12G & Nvidia-3090 24G

|

| 293 |

+

|

| 294 |

+

Linux 的详细信息:

|

| 295 |

+

- 操作系统 Ubuntu 20.04, CentOS

|

| 296 |

+

- python: python3.10 & python3.11

|

| 297 |

+

- pytorch: torch2.2.0

|

| 298 |

+

- CUDA: 11.8 & 12.1

|

| 299 |

+

- CUDNN: 8+

|

| 300 |

+

- GPU:Nvidia-V100 16G & Nvidia-A10 24G & Nvidia-A100 40G & Nvidia-A100 80G

|

| 301 |

+

|

| 302 |

+

我们需要大约 60GB 的可用磁盘空间,请检查!

|

| 303 |

+

|

| 304 |

+

#### b. 权重放置

|

| 305 |

+

我们最好将[权重](#model-zoo)按照指定路径进行放置:

|

| 306 |

+

|

| 307 |

+

**通过comfyui**:

|

| 308 |

+

将模型放入Comfyui的权重文件夹`ComfyUI/models/Fun_Models/`:

|

| 309 |

+

```

|

| 310 |

+

📦 ComfyUI/

|

| 311 |

+

├── 📂 models/

|

| 312 |

+

│ └── 📂 Fun_Models/

|

| 313 |

+

│ ├── 📂 CogVideoX-Fun-V1.1-2b-InP/

|

| 314 |

+

│ ├── 📂 CogVideoX-Fun-V1.1-5b-InP/

|

| 315 |

+

│ ├── 📂 Wan2.1-Fun-V1.1-14B-InP

|

| 316 |

+

│ └── 📂 Wan2.1-Fun-V1.1-1.3B-InP/

|

| 317 |

+

```

|

| 318 |

+

|

| 319 |

+

**运行自身的python文件或ui界面**:

|

| 320 |

+

```

|

| 321 |

+

📦 models/

|

| 322 |

+

├── 📂 Diffusion_Transformer/

|

| 323 |

+

│ ├── 📂 CogVideoX-Fun-V1.1-2b-InP/

|

| 324 |

+

│ ├── 📂 CogVideoX-Fun-V1.1-5b-InP/

|

| 325 |

+

│ ├── 📂 Wan2.1-Fun-V1.1-14B-InP

|

| 326 |

+

│ └── 📂 Wan2.1-Fun-V1.1-1.3B-InP/

|

| 327 |

+

├── 📂 Personalized_Model/

|

| 328 |

+

│ └── your trained trainformer model / your trained lora model (for UI load)

|

| 329 |

+

```

|

| 330 |

+

|

| 331 |

+

# 如何使用

|

| 332 |

+

|

| 333 |

+

<h3 id="video-gen">1. 生成 </h3>

|

| 334 |

+

|

| 335 |

+

#### a、显存节省方案

|

| 336 |

+

由于Wan2.2的参数非常大,我们需要考虑显存节省方案,以节省显存适应消费级显卡。我们给每个预测文件都提供了GPU_memory_mode,可以在model_cpu_offload,model_cpu_offload_and_qfloat8,sequential_cpu_offload中进行选择。该方案同样适用于CogVideoX-Fun的生成。

|

| 337 |

+

|

| 338 |

+

- model_cpu_offload代表整个模型在使用后会进入cpu,可以节省部分显存。

|

| 339 |

+

- model_cpu_offload_and_qfloat8代表整个模型在使用后会进入cpu,并且对transformer模型进行了float8的量化,可以节省更多的显存。

|

| 340 |

+

- sequential_cpu_offload代表模型的每一层在使用后会进入cpu,速度较慢,节省大量显存。

|

| 341 |

+

|

| 342 |

+

qfloat8会部分降低模型的性能,但可以节省更多的显存。如果显存足够,推荐使用model_cpu_offload。

|

| 343 |

+

|

| 344 |

+

#### b、通过comfyui

|

| 345 |

+

具体查看[ComfyUI README](https://github.com/aigc-apps/VideoX-Fun/tree/main/comfyui)。

|

| 346 |

+

|

| 347 |

+

#### c、运行python文件

|

| 348 |

+

- 步骤1:下载对应[权重](#model-zoo)放入models文件夹。

|

| 349 |

+

- 步骤2:根据不同的权重与预测目标使用不同的文件进行预测。当前该库支持CogVideoX-Fun、Wan2.1、Wan2.1-Fun、Wan2.2,在examples文件夹下用文件夹名以区分,不同模型支持的功���不同,请视具体情况予以区分。以CogVideoX-Fun为例。

|

| 350 |

+

- 文生视频:

|

| 351 |

+

- 使用examples/cogvideox_fun/predict_t2v.py文件中修改prompt、neg_prompt、guidance_scale和seed。

|

| 352 |

+

- 而后运行examples/cogvideox_fun/predict_t2v.py文件,等待生成结果,结果保存在samples/cogvideox-fun-videos文件夹中。

|

| 353 |

+

- 图生视频:

|

| 354 |

+

- 使用examples/cogvideox_fun/predict_i2v.py文件中修改validation_image_start、validation_image_end、prompt、neg_prompt、guidance_scale和seed。

|

| 355 |

+

- validation_image_start是视频的开始图片,validation_image_end是视频的结尾图片。

|

| 356 |

+

- 而后运行examples/cogvideox_fun/predict_i2v.py文件,等待生成结果,结果保存在samples/cogvideox-fun-videos_i2v文件夹中。

|

| 357 |

+

- 视频生视频:

|

| 358 |

+

- 使用examples/cogvideox_fun/predict_v2v.py文件中修改validation_video、validation_image_end、prompt、neg_prompt、guidance_scale和seed。

|

| 359 |

+

- validation_video是视频生视频的参考视频。您可以使用以下视频运行演示:[演示视频](https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/cogvideox_fun/asset/v1/play_guitar.mp4)

|

| 360 |

+

- 而后运行examples/cogvideox_fun/predict_v2v.py文件,等待生成结果,结果保存在samples/cogvideox-fun-videos_v2v文件夹中。

|

| 361 |

+

- 普通控制生视频(Canny、Pose、Depth等):

|

| 362 |

+

- 使用examples/cogvideox_fun/predict_v2v_control.py文件中修改control_video、validation_image_end、prompt、neg_prompt、guidance_scale和seed。

|

| 363 |

+

- control_video是控制生视频的控制视频,是使用Canny、Pose、Depth等算子提取后的视频。您可以使用以下视频运行演示:[演示视频](https://pai-aigc-photog.oss-cn-hangzhou.aliyuncs.com/cogvideox_fun/asset/v1.1/pose.mp4)

|

| 364 |

+

- 而后运行examples/cogvideox_fun/predict_v2v_control.py文件,等待生成结果,结果保存在samples/cogvideox-fun-videos_v2v_control文件夹中。

|

| 365 |

+

- 步骤3:如果想结合自己训练的其他backbone与Lora,则看情况修改examples/{model_name}/predict_t2v.py中的examples/{model_name}/predict_i2v.py和lora_path。

|

| 366 |

+

|

| 367 |

+

#### d、通过ui界面

|

| 368 |

+

|

| 369 |

+

webui支持文生视频、图生视频、视频生视频和普通控制生视频(Canny、Pose、Depth等)。在examples文件夹下用文件夹名以区分,不同模型支持的功能不同,请视具体情况予以区分。以CogVideoX-Fun为例。

|

| 370 |

+

|

| 371 |

+

- 步骤1:下载对应[权重](#model-zoo)放入models文件夹。

|

| 372 |

+

- 步骤2:运行examples/cogvideox_fun/app.py文件,进入gradio页面。

|

| 373 |

+

- 步骤3:根据页面选择生成模型,填入prompt、neg_prompt、guidance_scale和seed等,点击生成,等待生成结果,结果保存在sample文件夹中。

|

| 374 |

+

|

| 375 |

+

# 参考文献

|

| 376 |

+

- CogVideo: https://github.com/THUDM/CogVideo/

|

| 377 |

+

- EasyAnimate: https://github.com/aigc-apps/EasyAnimate

|

| 378 |

+

- Wan2.1: https://github.com/Wan-Video/Wan2.1/

|

| 379 |

+

- Wan2.1: https://github.com/Wan-Video/Wan2.2/

|

| 380 |

+

- ComfyUI-KJNodes: https://github.com/kijai/ComfyUI-KJNodes

|

| 381 |

+

- ComfyUI-EasyAnimateWrapper: https://github.com/kijai/ComfyUI-EasyAnimateWrapper

|

| 382 |

+

- ComfyUI-CameraCtrl-Wrapper: https://github.com/chaojie/ComfyUI-CameraCtrl-Wrapper

|

| 383 |

+

- CameraCtrl: https://github.com/hehao13/CameraCtrl

|

| 384 |

+

|

| 385 |

+

# 许可证

|

| 386 |

+

本项目采用 [Apache License (Version 2.0)](https://github.com/modelscope/modelscope/blob/master/LICENSE).

|